自动驾驶遇到三大定律:做一个合格的机器人不容易

随着人工智能技术的快速发展,机器人已经逐渐融入我们的生活。从快餐店的自助点餐设备到家用扫地机器人到自动驾驶汽车,机器人在我们的日常生活和工作中有着多种形式。那么阿西莫夫著名的机器人三定律是否适用于这些逐渐融入我们生活的机器人呢?

随着人工智能的发展,机器人被广泛应用于我们的日常生活中。以前看起来很贵只能用于重型制造的机器人,逐渐向低成本、小型化发展。虽然我们还没有制造出我们梦想中的管家机器人来照顾我们的日常生活,但家用吸尘器实际上可以被视为一种机器人。

关于机器人,许多人都听说过作家艾萨克阿西莫夫的机器人三定律。1942年他的科幻小说《Runaround》出版后,人们对这一传奇定律的兴趣和热情似乎不可阻挡。

机器人三定律源于阿西莫夫的科幻小说。

阿西莫夫的三大定律如下:

1.机器人一定不能伤害人类,或者坐视人类受到伤害;

2.机器人必须服从人类给它的命令,除非这些命令与第一定律相冲突;

3.机器人在不违反第一定律或第二定律的前提下,必须保护自己的存在。

后来,阿西莫夫加入了一项新的法律,“零定律”,规定“机器人不得伤害整个人类,或因不作为而伤害整个人类。”

阿西莫夫的机器人三定律

阿西莫夫虽然提出了这些规律,但并不是真正的规律。这些法律是人为制定的,人类可以自由控制。我们可以遵守,也可以完全无视,选择权完全在我们。法律其实就是人类制定的规章制度。从这个角度来看,阿西莫夫提出的机器人三大定律,应该很有可能被写进我们的定律里,因为未来某个时期,机器人很有可能会和我们一起流浪街头。这样做是明智的。

不管机器人采取什么形式,这三条定律都适用

当提到阿西莫夫的机器人三定律时,人们可能想用“人”这个词来代替人工智能。因为你可能会从狭义上思考,好像它们只适用于一个看起来像人类的机器人,有腿、胳膊、头和身体,等等。但并不是所有的机器人都必须这样设计。

未来的机器人可以是任何形状。

一些最新的机器人看起来更像动物。也许你看过一些流行的网络视频,里面有些机器人看起来像狗,甚至像昆虫机器人。它们看起来有点可怕,但它们可以帮助我们找到如何使用机器人来实现各种可能性。

机器人设计不一定要受生物学启发。比如自动吸尘器,看起来不像什么常见的动物或者昆虫。可以预料,未来会有各种各样的机器人,而且似乎不仅仅是基于生物学。

无论我们要造什么样的机器人,阿西莫夫三定律都是非常有用的。这可能有点牵强,但吸尘器确实可以成为遵守三大定律的候选对象。当然,你家里的吸尘器“机器人”不会试图伤害你,但应该尽一切可能避免这样做。

有些机器人出现在我们眼前,但我们可能不认为它们是机器人。基于人工智能的自动驾驶汽车就是一个例子。

三定律未来或可编入真正的法律当中

人工智能系统驱动的汽车可以说是机器人。而你可能不认同他们的机器人身份,因为它没有一个会走路会说话的机器人坐在驾驶座上。负责驾驶的计算机系统隐藏在汽车的底盘或行李箱中。虽然它确实是一个机器人,但它的真实身份似乎经常被忽视。

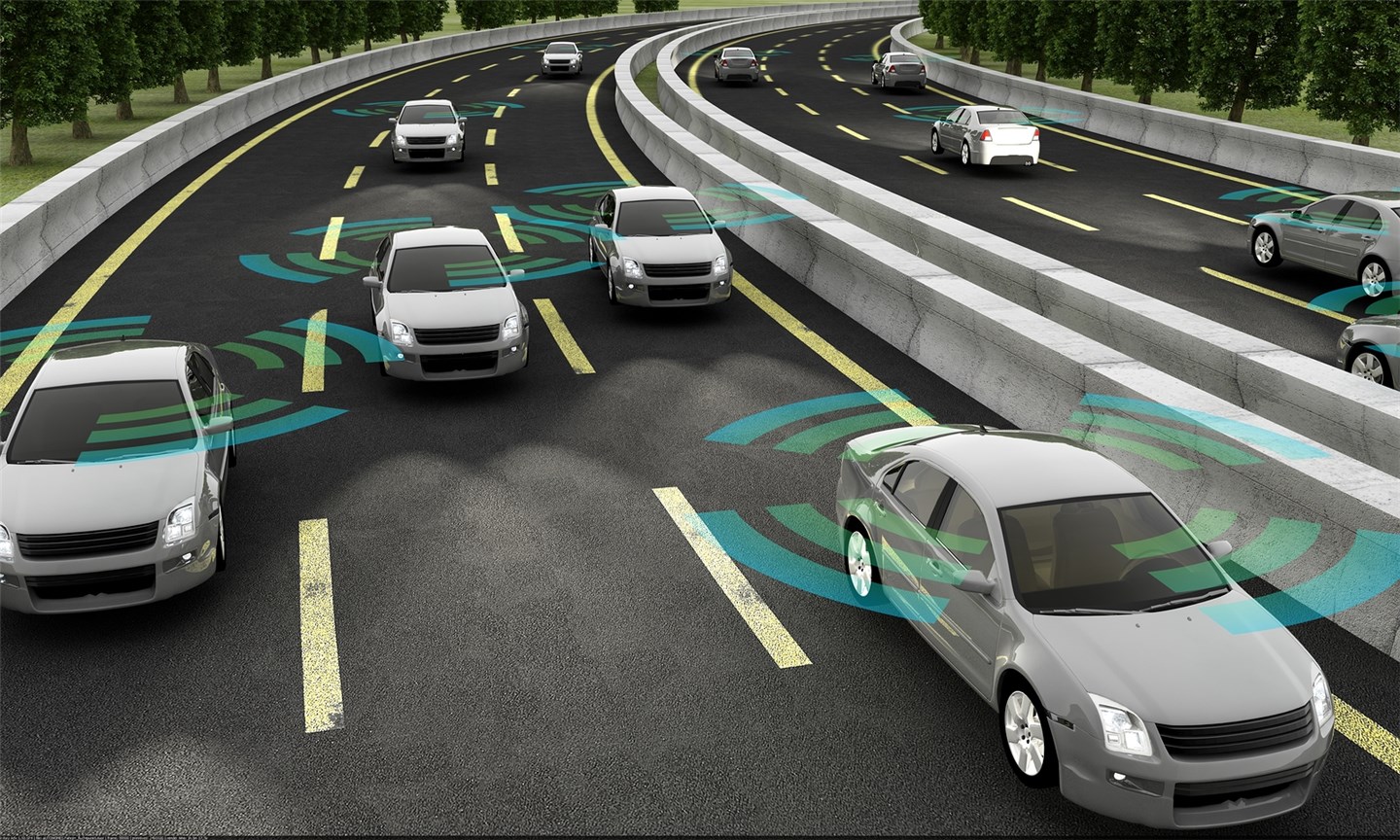

自动驾驶汽车已经在路上测试过了。

令人鼓舞的是,科学家们正在努力创造能够行走和说话的机器人,他们将能够驾驶汽车。想象一下它们会给我们的世界带来什么变化。

目前,自驾汽车都是由汽车改装而来的。如果我们制造的机器人可以驾驶汽车,那就意味着现有的所有汽车基本上都可以算是自驾汽车。我们不需要因为自驾汽车的到来而抛弃传统汽车,也不需要设计全自动驾驶汽车。那些行走机器人可以充当我们的司机。

目前,制造自动驾驶汽车最快的方法是将机器人制造成汽车。有些人认为,这些新型自动驾驶汽车将不可避免地被会走路和说话的机器人所取代。也就是说,今天的自动驾驶汽车将会过时,再次让位于传统的驾驶控制模式,这意味着汽车将由人类或机器人驾驶。

另外,有人希望当我们在自驾汽车领域走得足够远的时候,就不再用独立的机器人来开车了。

自动驾驶系统与机器人驾驶员

如果机器人驾驶员控制方向盘,意味着传统的驾驶控制将保留。这也意味着人们仍然可以想开多久就开多久。但人们相信,人工智能无论是内置驾驶系统还是行走机器人,都会成为更好的驾驶员,能够减少酒后驾车等不良驾驶行为。事实上,真正的自动驾驶汽车不会有任何驾驶控制功能,这可能会使独立的机器人和人类无法驾驶汽车。

将来,独立机器人可能会成为人类的驾驶员。

人们可能会有这样的想法,的世界将完全转向真正的自动驾驶汽车。虽然一个会走路会说话的驾驶机器人可能会实现,但也许自主驾驶技术的发展会让人们不愿意让时间倒流,重新推出传统汽车。这个想法看起来有点一厢情愿,但无论如何,自主驾驶的核心似乎是排除人类驾驶员。

这就引出了另一个关键的、有时被忽视的关于机器人的观点,即机器人可以被放置在涉及生死活动的位置上。你的家用吸尘器机器人不太可能是一个生死攸关的决策者。而内置人工智能驾驶系统的自驾汽车,甚至机器人驾驶员,无疑将处于决定人类生死命运的地位。

每天开车的时候,不管你意识到没有,你都是一个生死攸关的决策者。方向盘控制不好,你可能会死,别人也可能会死。虽然这看起来相当悲观,但也是一个需要强调的严酷现实。新手开车,对生死的恐惧突然变得相当明显。

既然这是一个生死攸关的问题,我们就应该考虑把阿西莫夫的三大定律应用到自主车的使用上。因此,我们有一个有趣的问题:阿西莫夫机器人三定律是否适用于基于人工智能的真实自主车辆?如果适用,我们应该怎么做?

从逻辑上来看一下问题所在

,需要澄清的是,真正的自驾汽车是指完全由人工智能独立驾驶,在驾驶过程中没有任何人工辅助的汽车。这些无人驾驶汽车被认为是4级和5级,而需要人类驾驶员一起驾驶的汽车通常被认为是2级或3级。后者被称为半自动驾驶,通常包括各种称为ADAS(高级驾驶员辅助系统)的自动附加部件。目前还没有真正的5级自驾汽车,我们甚至不知道是否可能,需要多长时间才能实现。与此同时,四级自动驾驶汽车也逐渐获得了一些在非常狭窄的特定公共道路上进行测试的机会。然而,是否应该进行这种测试存在很大争议。

真正的5级全自动驾驶汽车还没有出来。

对于半自动驾驶汽车,公众需要警惕最近一个令人不安的问题。有些司机在驾驶2级或3级汽车时拍摄了自己睡觉的视频。我们都需要避免被误导,以为司机开半自动车可以分散注意力。无论2级还是3级自动化水平如何,您都要对车辆的驾驶行为负责。

了解自动驾驶汽车的等级

对于4级和5级真正的自动驾驶汽车,驾驶过程中不会有人类驾驶员参与。全人类都是乘客,全程由人工智能系统驱动。先简单看一下阿西莫夫的三大定律,看看它们是如何应用到真正的自动驾驶汽车上的。第一定律:有挑战性!

首先,第一定律规定,机器人(或人工智能系统)无论是通过公开行动还是不作为,都不得伤害人类。当他们控制方向盘时,这是一个非常高的要求。为什么?

自动驾驶汽车在街道上行驶时,会主动检测周围环境。但是当一个孩子站在两辆停着的汽车之间时,它是看不见的,因为它超出了自动驾驶汽车的感知范围。当汽车以规定的速度行驶时,可能会发生儿童突然上街的情况。

有人认为,自动驾驶汽车永远不会撞到人,因为人工智能拥有最先进的感知能力,不会成为醉酒司机。不幸的是,在刚才设想的情况下,自动驾驶汽车必然会撞到孩子。之所以这样,是因为任何人工智能驱动系统都无法逃脱物理定律。

如果孩子突然出来,距离行驶的汽车15英尺(约4.5米),自驾汽车以30英里(48公里每小时)的速度行驶,其制动距离约为50-75英尺(15-23米),这意味着孩子很容易被撞。

这意味着人工智能驱动系统刚刚违反了阿西莫夫第一定律。人工智能伤人,但要保证人工智能系统会触发自动驾驶汽车的刹车,尽量避免撞到孩子。然而,人工智能系统没有足够的时间和距离来避免这种碰撞。

自动驾驶汽车也不是没有碰撞。

既然我们已经证明了严格遵守阿西莫夫第一定律是不可能的,那么你至少可以假设人工智能驱动系统试图遵守这个定律。通过刹车,人工智能驾驶系统似乎在努力避免撞到孩子,如果车子撞到的时候几乎停下来,结果可能没那么严重。

那么,第一定律也规定,不应该有不作为对人类造成伤害。有人认为,自驾汽车不尝试停车,这种不作为可能就属于这一类,即再次不守法。我们可以做一些其他的假设。假设人工智能驾驶系统可以转弯避免撞到小孩,但是自驾汽车撞到了树上,导致车内一名乘客扭伤了脖子。

虽然孩子得救了,但是自驾车上的乘客受伤了。你可以考虑一下救孩子和伤害乘客相比是否值得。此外,你还可以考虑人工智能是否未能采取适当措施避免对乘客造成伤害。这种道德困境非常适合自驾汽车。随着自动驾驶汽车的不断出现,应该引起更多的关注。

总之,阿西莫夫三大定律中的第一条,对于基于人工智能的全自动驾驶汽车来说,是一个非常具有挑战性的目标。虽然实现这个目标会非常困难,但这可能是我们必须解决的一个难题。

第二定律:人类命令如何不盲从?

阿西莫夫定律第二条规定,机器人或者人工智能的驱动系统应当服从人类赋予它的命令,除非人类发出的命令与第一定律相冲突。看起来简单愉快。但是这个法律也有它的问题。

曾经有一篇文章报道过一个人开车在桥上撞死一名持枪歹徒的故事。司机制止枪手的恶行是英雄行为。

如果把阿西莫夫第二定律编入自动车的人工智能驾驶系统,假设一个乘客指挥人工智能碾压枪手,人工智能很可能会拒绝这么做。这是显而易见的,因为这个指令会危害人类。但是,这个案例似乎推翻了我们一贯的做法。简而言之,认为第二定律应该实施是有依据的,否则就意味着在极少数情况下,会因不作为而对人类造成伤害。

问题是让人工智能驾驶系统毫无疑问的服从乘客是不切实际的。如果自动驾驶汽车的乘客告诉人工智能把汽车开到人行道上。这时人行道上没有行人,所以不会有人受伤。那么,人工智能驾驶系统应该服从人类发出的这个命令吗?

人工智能系统不会盲目听从乘客的命令。

人工智能当然不应该这么做。我们最终将不得不解决这个问题,以便人工智能驾驶系统能够判断人类乘客的哪些命令可以服从,哪些命令需要拒绝。

第三定律:如何保护自己?

阿西莫夫提出的第三定律是,只要第一、第二定律不被推翻,机器人或人工智能的驱动系统就必须保护其存在。那么无人驾驶汽车应该努力保护自己吗?

有些人认为自驾汽车的寿命约为4年,最终仅用4年就会严重磨损。这似乎令人惊讶,因为我们预计汽车会跑得更长,但自动驾驶汽车的不同之处在于,它们的行驶时间接近24小时,里程也比传统汽车长得多。

那么,假设一辆自驾汽车即将走到生命的尽头。车会自动开到垃圾场回收。人工智能驾驶系统可能决定不去回收中心试图保护自己,这种情况可以接受吗?如果有人让它去了那里,那么根据第二定律,自驾汽车必须遵守。

自动驾驶汽车和阿西莫夫的三定律

基于以上逻辑,我们不得不保留阿西莫夫三定律在自主车中的应用。人工智能驱动系统可以根据这些规律作为整体架构的一部分进行设计,但这些规律是一种愿望,而不是不可改变的规律。

在自主车正常化之前,必须解决道德困境。

开车存在巨大的道德困境,人们往往认为这是不可避免的。我们需要弄清楚人工智能驱动系统将如何在生死之间做出选择。这必须在自动驾驶汽车充斥街道之前完成。

大约80年前,阿西莫夫曾说过:“现在生活中最可悲的一面是,科学积累知识的速度快于社会积累智慧的速度。”但这句话值得我们回味。